Im Jahr 2026 ist die Entscheidung für Open-Source-Tools keine Frage der Leistungskompromisse mehr, sondern eine strategische Wahl für Datenschutz, Souveränität und Kostenkontrolle. Proprietäre Modelle punkten zwar weiterhin mit einfacher Zugänglichkeit, doch das Open-Source-Ökosystem bietet professionellen Anwendern und Unternehmen eine leistungsstarke, flexible und zukunftssichere Alternative.

Lokale Ausführung und Infrastruktur

Der Trend geht 2026 verstärkt zur lokalen Bereitstellung, um Datenschutz und Kontrolle zu gewährleisten.

Ollama

Ollama fungiert als Standard-Tool für die lokale Ausführung.

- Effizienz: Nutzt 4-Bit-Quantisierung, um Speicherbedarf ohne signifikanten Qualitätsverlust zu senken.

- Hardware-Support: Unterstützt Nvidia (bis zu 35 % schnellere Tokengenerierung durch offizielle Partnerschaft), AMD und Apple Silicon.

- Features: Desktop-App mit Chat-Interface, Drag-and-Drop für Dateien und strukturierte Outputs.

Open Web UI

Für eine benutzerfreundliche Interaktion auf Unternehmensniveau wird Open Web UI eingesetzt.

- Funktionen: Integriertes RAG-System (Retrieval Augmented Generation), Python-Code-Interpreter, Spracherkennung und Bildgenerierung.

- Sicherheit: Ermöglicht komplett offline-basierte, DSGVO-freundliche Workflows durch Docker-Deployment.

Open-Source KI Modelle

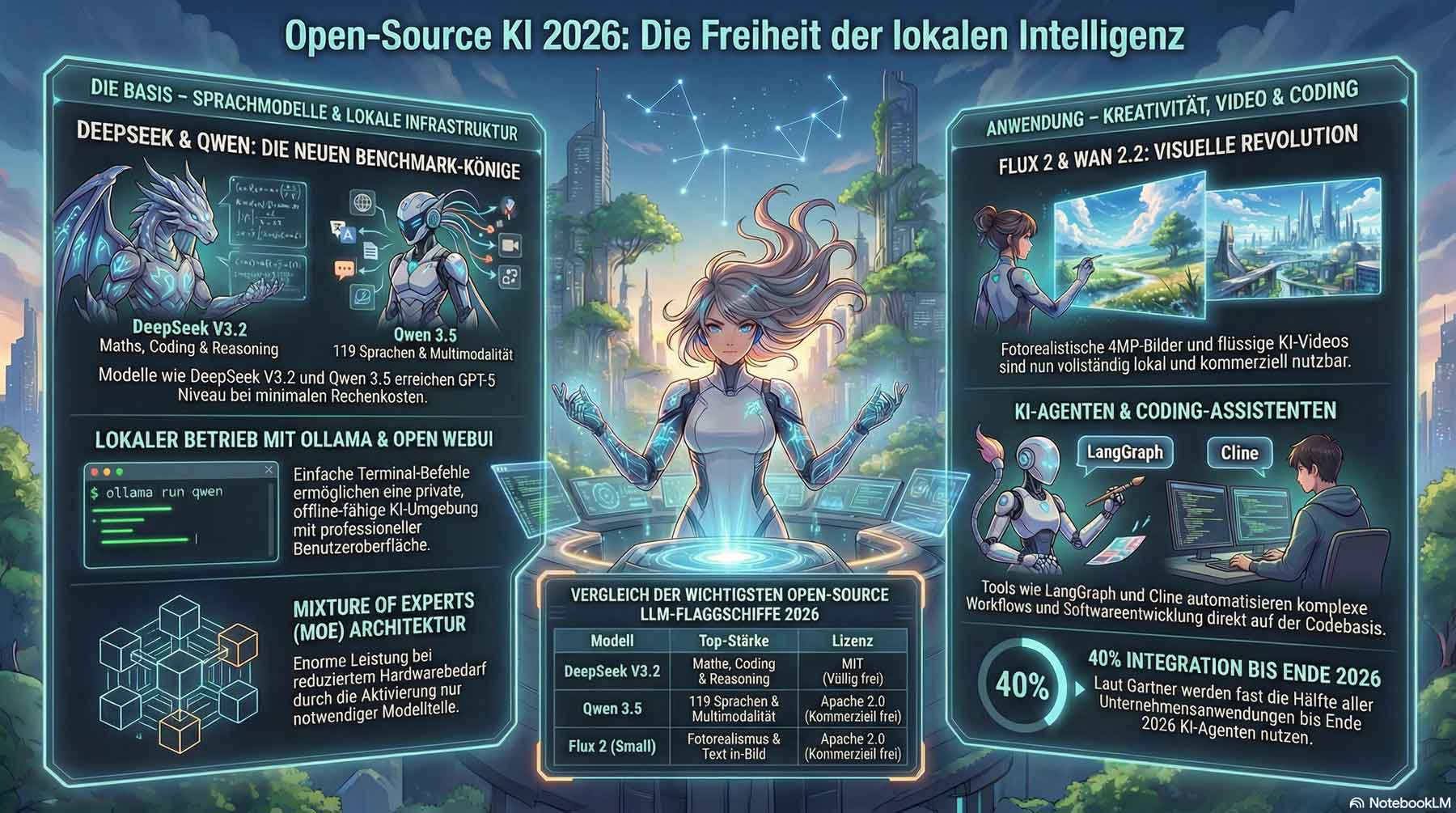

Proprietäre Modelle haben 2026 ihren Vorsprung verloren. Wer heute eine KI-Infrastruktur aufbaut, muss keine teuren Abonnements mehr abschließen. Die Open-Source-Welt liefert gute Leistungen.

Im Folgenden stellen ich euch die wichtigsten Modelle vor, sortiert nach ihrem Einsatzgebiet.

Text & Logik (LLMs)

- DeepSeek V3.2

Dieses Modell ist der aktuelle König der Reasoning-Klasse. Die Architektur basiert auf Mixture-of-Experts. Von insgesamt 671 Milliarden Parametern arbeiten pro Anfrage nur etwa 37 Milliarden. Das spart Rechenleistung. DeepSeek V3.2 schlägt GPT-5 in mathematischen Benchmarks und beim Programmieren. Es wechselt flüssig zwischen schnellen Antworten und tiefem Nachdenken.

Lizenz: MIT - Mistral 4

Die Entwickler aus Frankreich setzen weiterhin auf Effizienz. Mistral 4 ist kompakt und trotzdem extrem leistungsfähig. Es versteht komplexe Anweisungen besser als viele größere Konkurrenten. Das Modell ist besonders für den Betrieb auf eigenen Servern optimiert. Es bietet eine perfekte Balance zwischen Geschwindigkeit und Intelligenz.

Lizenz: Apache 2.0 - Qwen 3.6-Plus

Qwen 3.6-35B-A3B stellt einen signifikanten Qualitätssprung im Open-Source-Bereich dar. Durch die Kombination der effizienten MoE-Architektur, der hervorragenden Coding-Fähigkeiten und der Apache-2.0-Lizenz stellt es eine ernstzunehmende Alternative zu großen cloudbasierten Modellen dar. Es markiert den Punkt, an dem hocheffiziente KI-Agenten einer breiten Masse auf lokaler Standard-Hardware zugänglich werden.

Lizenz: Apache 2.0 - Llama 4 Scout

Metas neuestes Modell bietet einen extrem langen Kontext. Zehn Millionen Token passen in das Gedächtnis. Scout findet Informationen in riesigen Datenmengen punktgenau. Es ist das Rückgrat für moderne RAG-Systeme.

Lizenz: Llama 4 Community License - Gemma 4

Google liefert mit Gemma 4 ein Modell für lokale Workstations. Es verarbeitet Text, Bild und Audio in einer einzigen Architektur. Auf Consumer-Hardware erreicht es hohe Geschwindigkeiten.

Lizenz: Gemma Terms of Use (Permissive)

Bildgenerierung

- Flux 2

Black Forest Labs hat die Bildgenerierung verändert. Flux 2 erzeugt Fotos, die von echter Fotografie kaum zu unterscheiden sind. Text innerhalb von Bildern schreibt das Modell korrekt. Markenfarben lassen sich über Hex-Codes exakt steuern. Die kleinen Modelle laufen auf normaler Hardware.

Lizenz: Apache 2.0 (für die „Schnell“-Variante) - Stable Diffusion (SD 3.5 / XL)

Stable Diffusion bleibt das Herz der kreativen Community. Es ist zwar kein echtes Open Source im rechtlichen Sinn, aber die Gewichte liegen offen. Die Flexibilität ist unerreicht. Tausende Erweiterungen wie LoRAs oder ControlNet erlauben eine Präzision, die andere Modelle nicht bieten. Wer volle Kontrolle über seine Workflows braucht, kommt hier nicht vorbei.

Lizenz: Stability AI Community License (Gratis bis 1 Mio. $ Umsatz)

Videogenerierung

- Wan 2.2

Video-KI ist nicht mehr nur in der Cloud zu finden. Wan 2.2 generiert Clips in 720p. Die physikalischen Bewegungen wirken real. Kamerafahrten sind flüssig. Es arbeitet effizient auf normaler Hardware.

Lizenz: Apache 2.0 - Hunyuan Video

Tencents Modell ist für komplexe Szenen gebaut. Wenn viele Elemente gleichzeitig im Bild interagieren, behält Hunyuan die Logik bei. Es unterstützt Multi-GPU-Systeme.

Lizenz: Apache 2.0

Audio & Sprache

- Chatterbox (Resemble AI)

Chatterbox hat den Bereich Text-to-Speech übernommen. In Blindtests liegt es vor den großen Cloud-Anbietern. Stimmen klingen menschlich und transportieren echte Emotionen. Voice Cloning klappt mit nur fünf Sekunden Referenz-Audio.

Lizenz: MIT - Whisper (OpenAI)

Trotz seines Alters bleibt Whisper der Standard für Spracherkennung. Die Community hat das Modell stetig verbessert. Varianten wie Faster Whisper transkribieren Audio fast in Echtzeit. Es erkennt Akzente und filtert Hintergrundgeräusche zuverlässig.

Lizenz: MIT

Open-Source Agenten Frameworks

KI-Agenten, die autonom Aufgaben planen und ausführen, sind der zentrale Trend für 2026. Es wird prognostiziert, dass 40 % der Unternehmensanwendungen solche Agenten integrieren werden.

Frameworks im Vergleich:

LangGraph: Bietet maximale Kontrolle für Entwickler über komplexe Multi-Agenten-Systeme (MIT-Lizenz).

n8n: Visuelle Workflow-Automatisierung mit über 1100 Integrationen, geeignet für Anwender, die Low-Code bevorzugen. (ustainable Use License (Fair Code)

CrewAI: Fokussiert sich auf die Zusammenarbeit spezialisierter Agenten mit definierten Rollen, was den Einstieg in kollaborative KI-Teams sehr einfach macht. (MIT-Lizenz)

Aider & Cline: Spezialisierte Coding-Agenten, die Codebasen analysieren und Änderungen direkt in Git committen. (Apache License 2.0)

Fazit:

Unternehmen und Privatanwender haben 2026 erstmals die reale Möglichkeit, vollständige KI-Workflows DSGVO-konform, unabhängig und kosteneffizient auf eigener Infrastruktur zu betreiben.

Wenn du aber Open-Source-KI-Modelle wie Llama 3, Stable Diffusion oder Mistral lokal auf deinem eigenen Rechner betreiben möchtest, verlagert sich die Last direkt von der Cloud auf deine Hardware. Das ist zwar großartig für den Datenschutz, aber dein PC muss dafür leistungsstark genug sein.

Für die performante lokale Nutzung von Open-Source-KI ist eine leistungsstarke Grafikkarte mit viel VRAM entscheidend. Die gezielte Quantisierung der Modelle schlägt dabei die notwendige Brücke, um hohe Rechenlasten effizient mit der vorhandenen Hardware in Einklang zu bringen.