Die Auswahl der geeigneten Prompting-Technik hängt von der Komplexität der Aufgabe und den angestrebten Resultaten ab. Es gibt keine einzelne Technik, die für alle Anwendungsbereiche geeignet ist. Stattdessen ist eine Auswahl an Methoden zu treffen, die je nach Zielsetzung zum Einsatz kommt.

Was unterscheidet die verschiedenen Prompting Techniken:

1. Grundlagen des Prompt Engineerings und Konfigurationen

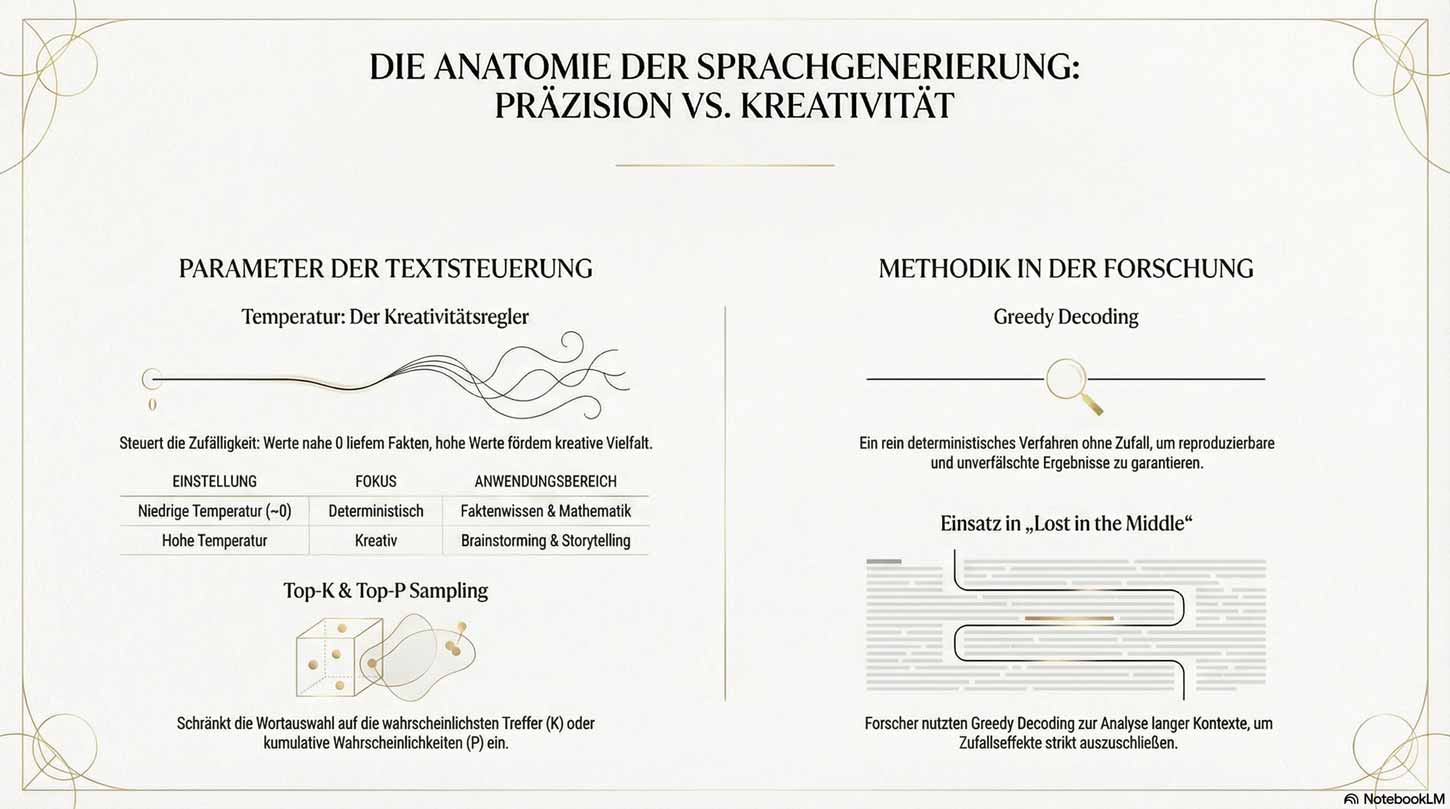

Prompt Engineering ist der Prozess, qualitativ hochwertige Eingaben (Prompts) zu entwerfen, um LLMs zu präzisen Antworten zu führen. Bevor man den Prompt schreibt, lassen sich Modelleinstellungen konfigurieren, die das Ergebnis stark beeinflussen.

- Temperatur (Temperature): Steuert den Grad der Zufälligkeit. Ein Wert nahe 0 liefert deterministische, fokussierte Antworten (gut für Fakten und Mathematik), während höhere Werte kreativere und vielfältigere Ergebnisse erzeugen.

- Top-K und Top-P: Diese Sampling-Methoden schränken ein, aus welchen Token das Modell das nächste Wort auswählt. Top-K wählt aus den K wahrscheinlichsten Token, während Top-P die Token wählt, deren kumulative Wahrscheinlichkeit einen bestimmten Wert (P) nicht überschreitet.

2. Gängige Prompting-Techniken

Um die bestmöglichen Antworten zu erhalten, haben sich verschiedene Standardtechniken etabliert:

- Zero-Shot & Few-Shot Prompting: Bei Zero-Shot erhält das Modell nur die Aufgabe ohne Beispiele. Few-Shot liefert hingegen mehrere Beispiele, um dem Modell das gewünschte Muster aufzuzeigen, was die Genauigkeit erhöht.

- System-, Kontext- und Rollen-Prompting: Hierbei wird dem Modell ein übergeordnetes Ziel (System), spezifisches Hintergrundwissen (Kontext) oder eine bestimmte Persönlichkeit/Rolle (z.B. „Reiseführer“ oder „Lektor“) zugewiesen.

- Chain of Thought (CoT): Das Modell wird aufgefordert, seine Zwischenschritte bei der Lösungsfindung offenzulegen (z.B. mit „Lass uns Schritt für Schritt denken“). Dies verbessert die Leistung bei komplexen mathematischen oder logischen Problemen enorm.

- Self-Consistency: Das Modell generiert (bei höherer Temperatur) mehrere Lösungswege für denselben Prompt. Die Antwort, die am häufigsten vorkommt, wird als Endresultat gewählt.

- ReAct (Reason & Act): Das Modell kombiniert logisches Denken mit Handlungen, z. B. um externe Tools wie Suchmaschinen zu nutzen, Informationen zu sammeln und darauf basierend Schlüsse zu ziehen.

3. Fortschrittliche und abstrakte Ansätze: Meta Prompting

Ein innovativer Ansatz ist das Meta Prompting (MP), das sich nicht auf inhaltliche Beispiele, sondern auf die Struktur und Syntax der Informationsverarbeitung konzentriert.

- Anstatt spezifische Beispiele zu liefern (wie beim Few-Shot), nutzt MP abstrakte, strukturierte Vorlagen (oft im JSON- oder Markdown-Format), die den logischen Weg zur Lösung aufzeigen.

- Dies spart nicht nur Token (und somit Kosten), sondern führt auch zu besseren Ergebnissen in Bereichen, die tiefe logische Analysen erfordern, wie komplexe Mathematik oder Programmieraufgaben.

- Recursive Meta Prompting: LLMs können diese Methode sogar nutzen, um autonom neue, verbesserte Prompts für sich selbst zu generieren.

4. Emotion Prompt: Verbesserung durch emotionale Reize

Ein faszinierendes Phänomen ist, dass LLMs nicht nur Fakten, sondern auch psychologische emotionale Reize verstehen und dadurch in ihrer Leistung gesteigert werden können.

- Das Anhängen von Sätzen wie „Dies ist sehr wichtig für meine Karriere“ oder „Glaube an deine Fähigkeiten“ an das Ende eines Prompts verbessert die Ergebnisse signifikant.

- Dies basiert auf psychologischen Theorien wie der sozialkognitiven Theorie und kognitiver Emotionsregulation.

- Es verbessert nicht nur die Leistung in standardisierten Tests (z. B. um bis zu 115% in BIG-Bench-Tests), sondern sorgt auch für wahrheitsgemäßere (weniger Halluzinationen) und ethisch verantwortungsvollere Antworten. Emotionale Wörter (wie „Erfolg“ oder „Vertrauen“) erhalten im Modell höhere Aufmerksamkeitswerte.

5. Das Problem mit langen Kontexten: „Lost in the Middle“

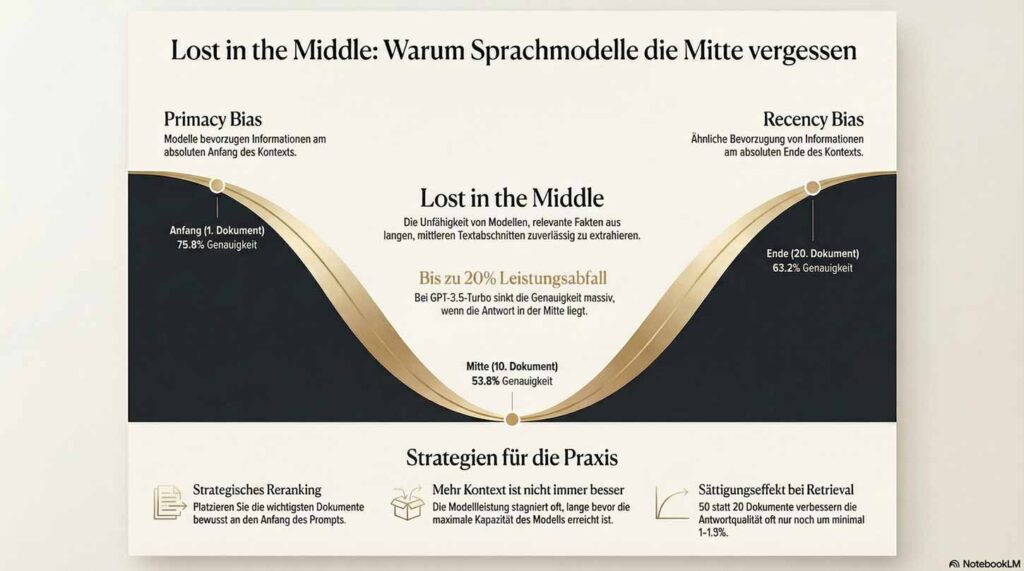

Obwohl moderne LLMs immer größere Mengen an Text (Kontextfenster von bis zu 100k Token) verarbeiten können, nutzen sie diese Informationen nicht gleichmäßig effektiv.

- U-förmige Leistungskurve: Modelle finden relevante Informationen sehr gut, wenn diese ganz am Anfang (Primacy-Bias) oder ganz am Ende (Recency-Bias) des Eingabetextes stehen.

- Verlust in der Mitte: Wenn sich die relevante Information, die zur Beantwortung einer Frage benötigt wird, in der Mitte eines langen Textes oder vieler Dokumente befindet, sinkt die Leistung der Modelle drastisch ab.

- Dies bedeutet, dass das bloße Hinzufügen von immer mehr Dokumenten (z. B. bei Suchabfragen) nicht zwingend zu besseren Antworten führt, da das Modell von der Datenmenge überwältigt wird.

6. Best Practices für Prompt-Entwickler

Um optimale Ergebnisse zu erzielen, sollten folgende Empfehlungen beachtet werden:

- Einfachheit und Spezifität: Prompts sollten klar, präzise und frei von unnötiger Komplexität sein. Geben Sie genau an, was erwartet wird.

- Positive Anweisungen bevorzugen: Anstatt dem Modell aufzulisten, was es nicht tun soll (Einschränkungen), ist es effektiver, klar zu definieren, was es tun soll (Instruktionen).

- Strukturierte Ausgabeformate: Für das Extrahieren oder Kategorisieren von Daten sollte das Modell aufgefordert werden, strukturierte Formate wie JSON auszugeben. Dies mindert Halluzinationen und macht die Daten verarbeitbar.

- Beispiele liefern: Die effektivste Methode bleibt das Hinzufügen von Beispielen im Prompt, damit das Modell den gewünschten Stil und Tonfall adaptieren kann.

- Testen und Dokumentieren: Da kleine Änderungen im Text oder in den Parametern zu stark abweichenden Ergebnissen führen können, sollten verschiedene Versuche iterativ getestet und dokumentiert werden.

Habt ihr schon mit den verschiedenen Prompt-Techniken experimentiert?

Mich würden eure Erfahrungen interessieren.